Anthropic doet het anders dan anderen: het AI-bedrijf wil in tegenstelling tot de rest van de concurrenten vooral meer doen met minder.

Concurrenten als OpenAI investeren miljarden in chips en megadatacenters. Bij deze bedrijven in Silicon Valley geldt schaal namelijk al jaren als de route naar succes, want wie de de meeste rekenkracht, data en infrastructuur kan verkrijgen, wint.

Verschillende uitgangspunten

Vooral OpenAI is het schoolvoorbeeld hiervan. Hun uitgangspunt is: grotere modellen, getraind met meer data en rekenkracht, worden voorspelbaar beter.

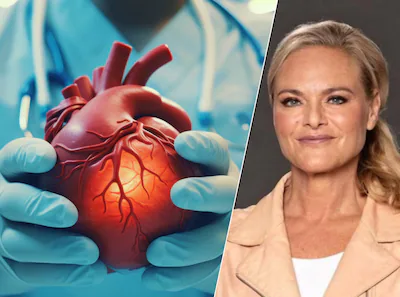

Anthropic onder leiding van Daniela Amodei wil nu bewijzen dat brute kracht niet de enige route naar de top is. Het bedrijf zet in op efficiëntere algoritmes, betere trainingsdata en post-trainingtechnieken die het redeneervermogen verbeteren, zonder dat de compute-kosten exploderen.

Flexibiliteit van Anthropic

Dat betekent overigens niet dat Anthropic helemaal niks meer investeert. Het bedrijf heeft zo’n 100 miljard dollar aan compute-afspraken en verwacht dat dat bedrag zal blijven groeien. Maar in vergelijking met rivalen probeert het flexibel te blijven: Anthropic laat zijn AI-modellen niet op één vaste plek draaien (bijvoorbeeld alleen op eigen datacenters of alleen bij één cloudbedrijf), maar op meerdere grote cloudplatforms tegelijk, zoals AWS, Google Cloud of anderen.

Daardoor hebben ze speelruimte. Als de rekenkracht bij de ene aanbieder duurder wordt, schaars is of vol zit, kunnen ze uitwijken naar een andere. Als klanten vooral bij een bepaalde cloud zitten, kunnen ze daar dichterbij draaien. Ze zitten dus niet vast aan één enorme, langjarige gok op één technische infrastructuur die misschien later te duur, inefficiënt of overbodig blijkt.

Als schaal zijn grenzen bereikt kan ‘meer doen met minder’ weleens een doorslaggevend voordeel blijken. Dat is de filosofie van Anthropic.